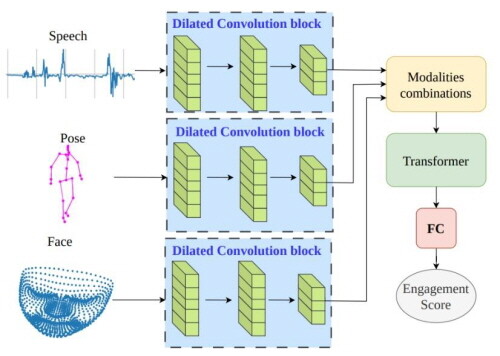

음성, 몸짓, 표정 정보로 측정하는 AI 알고리즘

|

| ▲ 연구 모식도 (사진=전남대학교 제공) |

[mdtoday=이재혁 기자] 국내 연구진에 의해 상대방이 대화에 집중하고 있는 정도를 파악할 수 있는 인공지능(AI) 기술이 개발됐다.

전남대학교 김수형 교수 연구팀은 상대방의 음성, 몸짓, 표정 정보를 가지고 상대방이 대화에 얼마나 집중하고 있는지 측정할 수 있는 AI 알고리즘을 제안했다고 8일 밝혔다.

사람은 상대방이 대화에 얼마나 집중하고 있는지를 직관적으로 알 수 있는 반면에, 컴퓨터는 상대방이 대화에 얼마나 집중하고 있는지를 수치화하여 파악하기는 어려웠다.

연구팀이 개발한 DCTM(Dilated Convolutional Transformer Model)은 chatGPT에 사용된 것과 같은 트렌스포머(Transformer) 모델의 전면부에 컨볼루션 신경망(convolutional neural network)을 결합해 인식 성능을 높인 AI 모델이다.

DCTM은 상대방의 몸짓과 표정, 음성 중에 어느 것이 서로 연관성을 가지고 중요한 정보를 포함하고 있는지를 스스로 판단하는 기능을 구현했다.

연구팀은 공개된 데이터베이스 실험을 통해 DCTM AI 모델이 기존 방법들의 성능을 능가한다는 결과를 입증했다.

연구의 결과는 올해 10월 캐나다 오타와에서 개최되는 최고 등급 국제학술대회 중 하나인 ACM 멀티미디어에서 발표될 예정이다.

메디컬투데이 이재혁 ([email protected])

[저작권자ⓒ 메디컬투데이. 무단전재-재배포 금지]